iPhone偺TrueDepth僇儊儔(iPhoneX,11,12摍偺慜柺僇儊儔乯偼丄偐側傝惓妋側僨僾僗儅僢僾偑嶌惉偱偒傞偲巚傢傟傞丅乽Record3D乿偲偄偆iPhone傾僾儕傪巊梡偡傞偙偲偱丄USB宱桼偱丄TrueDepth僇儊儔偱嶣塭偟偨RGB塮憸偲丄僨僾僗儅僢僾塮憸傪儕傾儖僞僀儉偵PC偵揮憲偱偒傞乮揮憲偱偒傞傛偆偵偡傞偵偼丄610墌偺壽嬥偑昁梫偱偡乯丅丂岞幃僒僀僩偺儕儞僋偵偁傞丄Python僾儘僌儔儉傪巊梡偡傞偙偲偱丄偙傟傪昞帵偱偒傞丅

偙偺RGB塮憸亄僨僾僗儅僢僾塮憸傪巊偭偰丄儕傾儖僞僀儉偵Looking Glass塮憸傪儗儞僟儕儞僌昞帵偡傞曽朄傪徯夘偡傞丅

側偍丄Lookig Glass Portrait偑惓幃偵敪憲偝傟傞傑偱偵偼丄Looking Glass幮偐傜丄摨條偺僣乕儖偑丄惓幃偵岞奐偝傟傞壜擻惈偑戝偒偄偑丄偳偺傛偆側僣乕儖偵側傞偐偼慡偔暘偐傝傑偣傫丅

1.丂PC偵乽Record3D乿偐傜偺僗僩儕乕儈儞僌塮憸昞帵僾儘僌儔儉乮Python)傪僀儞僗僩乕儖偡傞

偙偺儁乕僕偺愢柧偵廬偭偰乽demo-main.py乿偑摦嶌偡傞傛偆偵偡傞丅

Windows斉Python偺僀儞僗僩乕儖偼偙偪傜傪嶲徠壓偝偄丅

opencv-python傕僀儞僗僩乕儖偑昁梫偱偡丅僀儞僗僩乕儖曽朄偼丄偙偪傜傪偛嶲徠壓偝偄丅

2.丂乽Record3D乿傪TrueDepth僇儊儔晅偒偺iPhone偵僀儞僗僩乕儖偟丄儔僀僩僯儞僌働乕僽儖偱PC偲愙懕偡傞丅

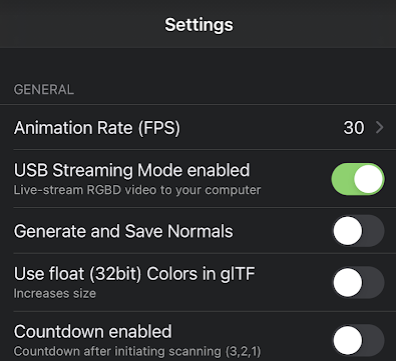

乽Record3D乿傾僾儕偺Setting偱丄乽USB Streaming Mode enabled乿傪ON偵偡傞乮梫壽嬥乯

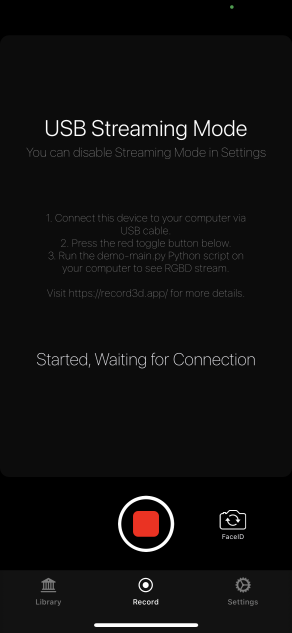

3.丂乽Record3D乿傾僾儕偺乽USB Streaming Mode乿夋柺偺壓偺愒偄儃僞儞傪墴偟攝怣Start偟傑偡丅

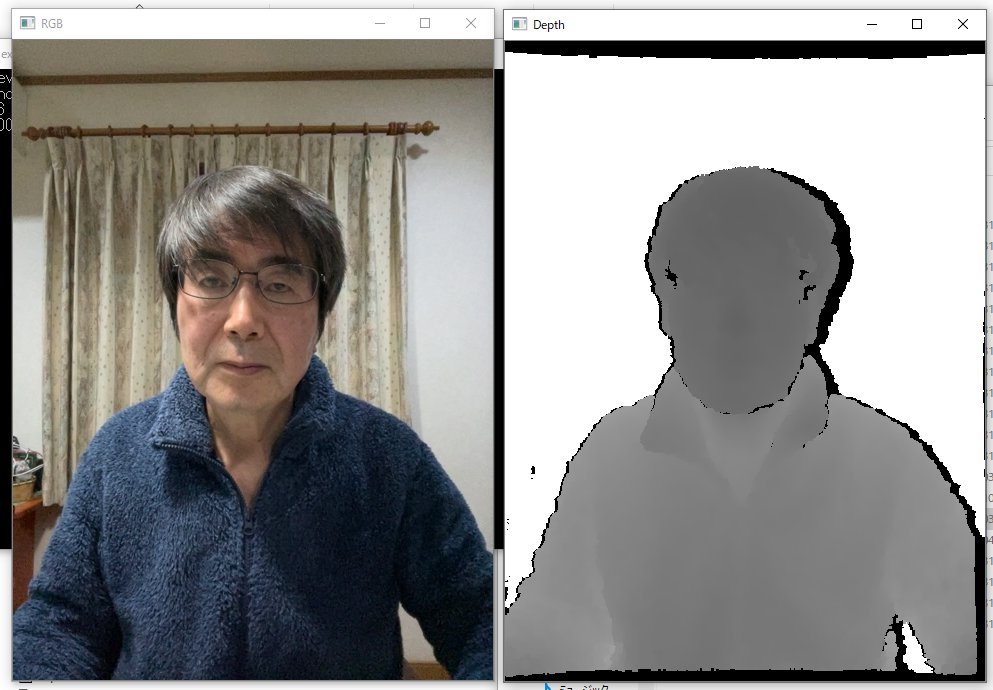

PC懁偱丄乽demo-main.py乿傪僟僽儖僋儕僢僋偟偰婲摦偡傞偲丄壓偺傛偆偵丄RGB偲僨僾僗儅僢僾偑暿乆偺僂傿儞僪僂偵昞帵偝傟傑偡丅

4.丂乽demo-main.py乿傪夵椙偟偨Python僾儘僌儔儉(2021/1/18偵峏怴偟偰壖憐僇儊儔偵捈愙弌椡偱偒傞傛偆偵偟傑偟偨乯傪僟僂儞儘乕僪偟丄ZIP僼傽僀儖傪夝搥偟偨python僾儘僌儔儉傪丄忋婰岞幃僣乕儖傪僀儞僗僩乕儖偟偨僼僅儖僟(\record3d)偵僐僺乕偡傞丅

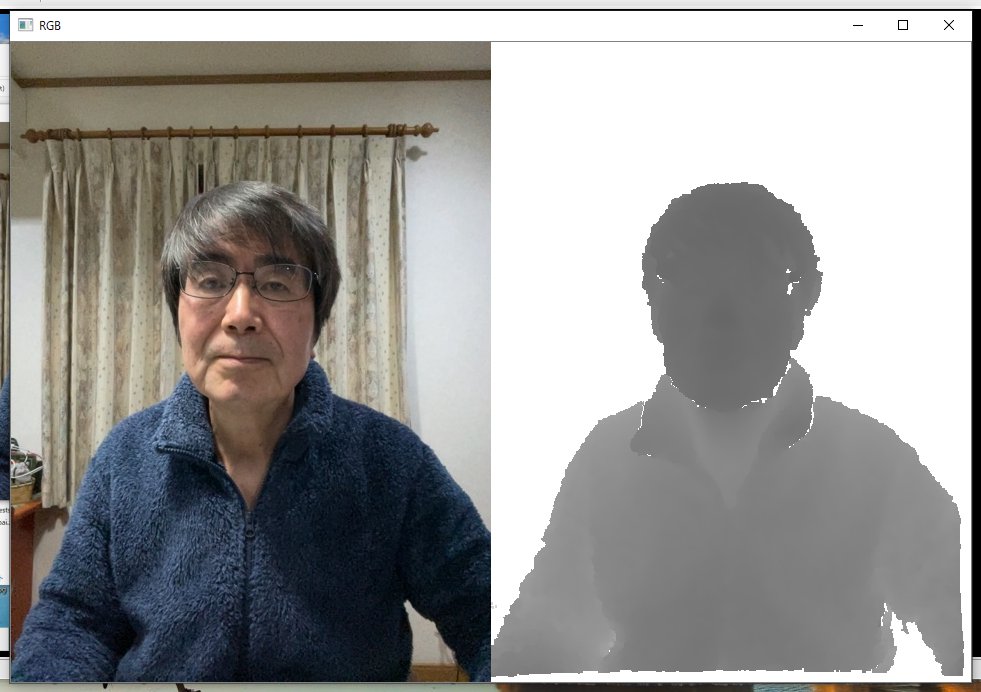

乽demo-main_modbysuto.py乿傪僟僽儖僋儕僢僋偟偰婲摦偡傞偲丄壓偺傛偆偵丄RGB偲僨僾僗儅僢僾偑SBS塮憸偲偟偰傂偲偮偺僂傿儞僪僂偵昞帵偝傟傑偡丅

夵椙億僀儞僩偼丄SBS偺堦偮偺塮憸偵偟偨懠丄懳徾暔偺廃傝偺崟傪敀偵曄峏丄偝傜偵丄乽Q乿僉乕偱廔椆偡傞傛偆偵偟偨懠丄iPhone偺廲/墶攝抲丄壖憐WEB僇儊儔傊偺捈愙弌椡摍偵懳墳偟傑偟偨丅徻偟偔偼丄揧晅偺Readme_jpn.txt傪偍撉傒壓偝偄

5. 嵟怴斉偱偼丄OBS Studio傪巊梡偟側偔偰傕丄捈愙壖憐WEB僇儊儔塮憸偲偟偰弌椡偱偒傞傛偆偵偟傑偟偨

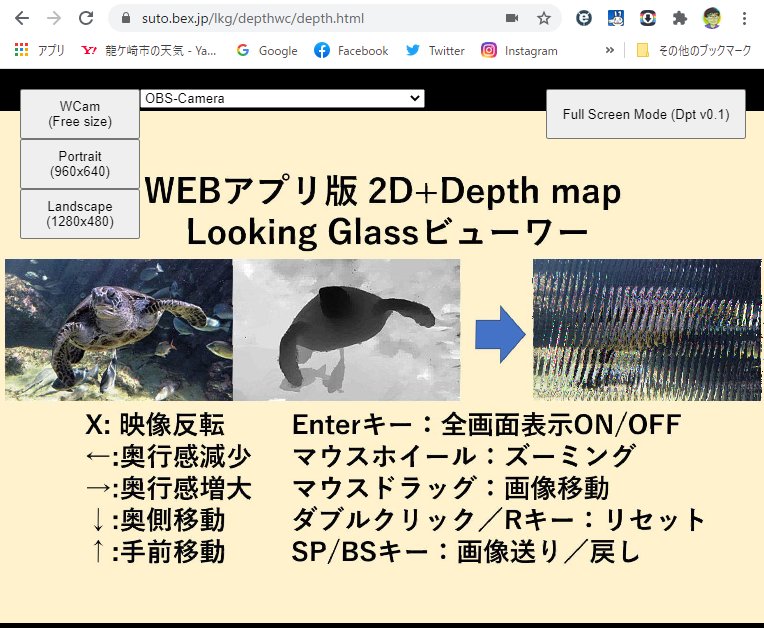

| a) 忋婰偺塃夋憸乛僨僾僗儅僢僾偺SBS昞帵傪OBS Studio偱WEB僇儊儔塮憸偲偟偰弌椡偡傞丅 |

| b) PC偲Looking Glass傪愙懕偟丄Google Chrome僽儔僂僓偱乽https://suto.bex.jp/lkg/depthwc/depth.html乿傪奐偔 僇儊儔慖戰儃僢僋僗偱丄OBS-Camera傪妋擣偟丄iPhone廲抲偒偺帪偼丄乽Portrait(960x640)乿丄墶抲偒偺帪偼丄乽Landscape(1280x480)乿儃僞儞傪墴偡  |

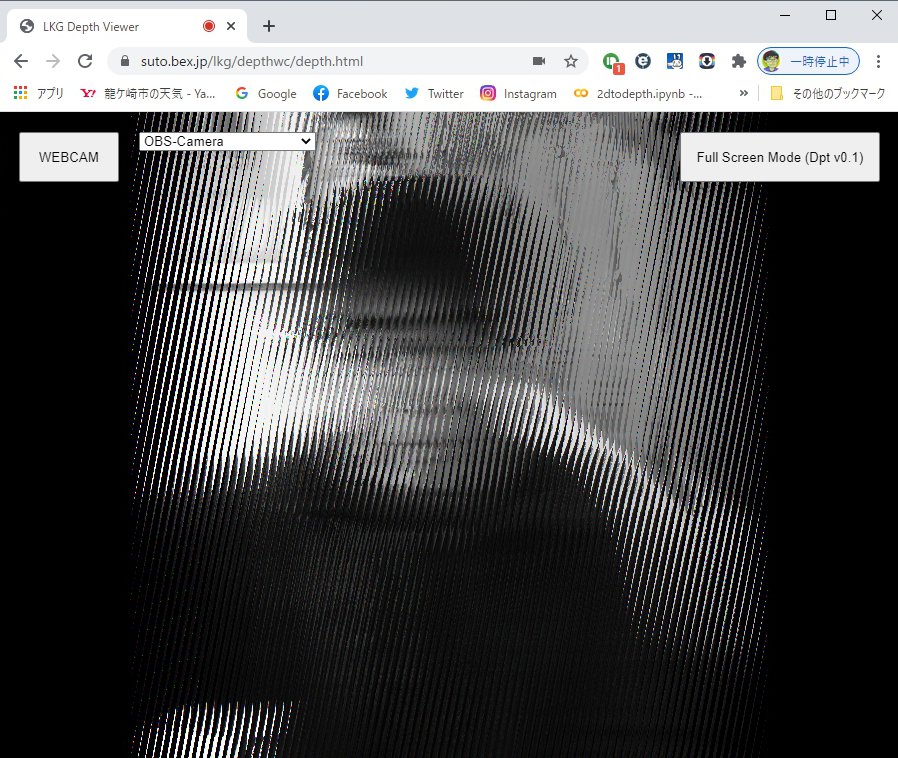

| d) 壓偺傛偆偵丄Looking Glass梡偺儗儞僟儕儞僌偝傟偨塮憸偑昞帵偝傟傞偺偱丄偙偺僂傿儞僪僂傪Looking

Glass偵堏摦偟丄Full Screen Mode儃僞儞 傪墴偡偲丄Looking Glass偵慡夋柺昞帵偝傟傞丅  |